Hace 5 años desde que se hicieron uno de los mayores esfuerzos recientes para definir las bases para el futuro desarrollo de una Inteligencia Artificial beneficiosa para la humanidad. Son los llamados Principios Asilomar de Inteligencia Artificial, que están marcado las bases de numerosas políticas internacionales al respecto. Hoy los recordamos por la trascendencia que tienen en el desarrollo de una super-inteligencia que realmente sea “inteligente”.

Estamos ante una clara exponencialidad de desarrollos en métodos de aprendizaje automático, analítica y automatización, combinado con grandes avances en la computación cuántica y la capacidad de verificación que ofrece blockchain. Esto plantea la llegada de un verdadero punto de inflexión en la historia de la humanidad.

Aunque no todas las personas que trabajan en este campo coinciden sobre cuando y cómo se producirá está inflexión, existe un consenso sobre la importancia de definir principios compartidos que garanticen un futuro de la super-inteligencia alineado con nuestros valores y necesidades humanas .

En enero de 2017 se inició un gran movimiento mundial impulsado por el Future of Life Institute, para la organización del segundo encuentro sobre Inteligencia Artificial Beneficiosa (BAI 2017), donde se sentaron las bases para el desarrollo de la Inteligencia Artificial del futuro.

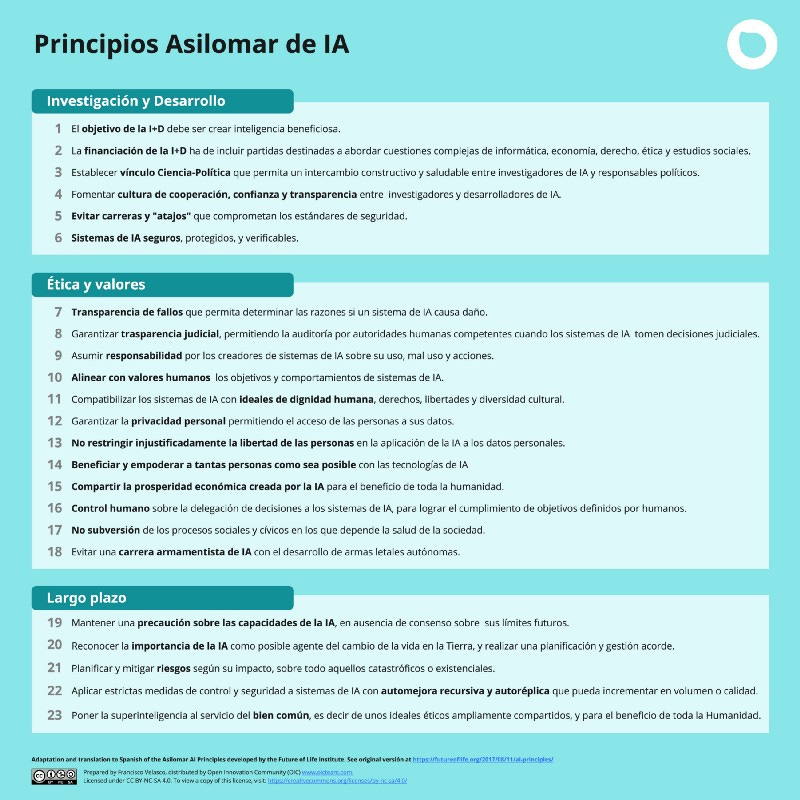

El resultado fue la elaboración de los Principios Asilomar de la IA, que he querido reproducir de forma super-simplificada en el siguiente gráfico con el propósito de facilitar su divulgación a empresas, administraciones y organizaciones interesadas:

Los Principios Asilomar de la IA están divididos en 3 categorías: Investigación, Ética y Valores, y Largo plazo. A continuación se proporciona una traducción más literal de los mismos:

Investigación

1. Objetivo de la investigación: el objetivo de la investigación de la IA no debe ser crear inteligencia no dirigida, sino inteligencia beneficiosa.

2. Financiación de la I+D: las inversiones en IA deben incluir partidas destinadas a garantizar su uso beneficioso, incluyendo el abordaje de cuestiones complejas en informática, economía, derecho, ética y estudios sociales, como por ejemplo:

¿Cómo podemos desarrollar futuros sistemas de IA altamente robustos, para que hagan lo que queremos, sin fallar ni ser pirateados?

¿Cómo podemos aumentar nuestra prosperidad a través de la automatización mientras mantenemos los recursos y el propósito de las personas?

¿Cómo podemos actualizar nuestros sistemas legales para que sean más justos y eficientes, para mantener el ritmo de la IA y para gestionar los riesgos asociados con la IA?

¿Con qué conjunto de valores debe alinearse la IA y qué estatus legal y ético debe tener?

3. Vínculo ciencia-política: debe haber un intercambio constructivo y saludable entre los investigadores de IA y los responsables políticos.

4. Cultura de investigación: se debe fomentar una cultura de cooperación, confianza y transparencia entre los investigadores y desarrolladores de IA.

5. Prevención de carreras: los equipos que desarrollan sistemas de IA deben cooperar activamente para evitar que se tomen atajos que comprometan los estándares de seguridad.

Ética y Valores

6. Seguridad: los sistemas de IA deben ser seguros, estar protegidos durante toda su vida útil , y ser verificables cuando sea aplicable y factible.

7. Transparencia en los fallos: si un sistema de IA causa daño, debe ser posible determinar por qué.

8. Transparencia Judicial: cualquier intervención de un sistema autónomo en la toma de decisiones judiciales debe ir acompañada de una explicación satisfactoria y auditable por parte de una autoridad humana competente.

9. Responsabilidad: los diseñadores y constructores de sistemas avanzados de IA son partes interesadas en las implicaciones morales de su uso, mal uso y acciones, teniendo la responsabilidad y oportunidad de amoldar esas implicaciones.

10. Alineación de valores: los sistemas de IA altamente autónomos deben diseñarse de manera que sus objetivos y comportamientos estén alineados con los valores humanos a lo largo de su vida útil.

11. Valores humanos: los sistemas de IA deben diseñarse y operarse de modo que sean compatibles con los ideales de dignidad humana, derechos, libertades y diversidad cultural.

12. Privacidad personal: las personas deben tener derecho a acceder, administrar y controlar los datos que generan, considerando el poder de los sistemas de inteligencia artificial para analizar y utilizar esos datos.

13. Libertad y privacidad: la aplicación de la IA a los datos personales no debe restringir injustificadamente la libertad, real o percibida, de las personas.

14. Beneficio compartido: las tecnologías de IA deberían beneficiar y empoderar a tantas personas como sea posible.

15. Prosperidad compartida: la prosperidad económica creada por la IA debe compartirse ampliamente, para el beneficio de toda la humanidad.

16. Control humano: los seres humanos deberían elegir cómo delegar, y si delegar, decisiones a los sistemas de IA para lograr el cumplimiento de objetivos definidos por humanos

17. No subversión: El poder conferido por el control de sistemas de IA altamente avanzados debe respetar y mejorar, en lugar de subvertir, los procesos sociales y cívicos de los que depende la salud de la sociedad.

18. Carrera armamentista de IA: se debe evitar una carrera armamentista de armas letales autónomas.

Largo Plazo

19. Precaución de Capacidad: al no haber un consenso generalizado, se debe evitar hacer suposiciones muy marcadas sobre los límites superiores de las futuras capacidades de la IA.

20. Importancia: la IA avanzada podría suponer un profundo cambio en la historia de la vida en la Tierra, y debe ser planificada y gestionada con cuidados y recursos acordes.

21. Riesgos: los riesgos asociados a los sistemas de IA, especialmente los catastróficos o existenciales, deben estar sujetos a esfuerzos de planificación y mitigación equiparables al impacto previsto.

22. Auto-mejora recursiva: los sistemas de IA diseñados para la auto-mejora recursiva la auto-réplica que pudieran suponer un incremento rápido de su calidad y cantidad, deben estar sujetos a estrictas de control y seguridad.

23. Bien común: la super-inteligencia debe ser desarrollada sólo en servicio de unos ideales éticos ampliamente compartidos, y para el beneficio de toda la Humanidad, más que para el de un Estado u organización

— — — — — —

Estos principios suponen un importante consenso por parte de la comunidad de investigación y desarrollo de la IA a nivel global. Además plantean las bases para garantizar la construcción de sistemas de IA seguros, fiables y alineados con las necesidades humanas, que prevengan futuros distópicos.

Cinco años después de su publicación, podemos ver cómo muchos países y bloques geopolíticos (como la Unión Europea) avanzan en la creación de leyes y regulaciones fundamentadas en los Principios Asilomar de la IA, lo cual es altamente positivo. Si bien, es importante que contribuyamos a su difusión para maximizar la conciencia colectiva acerca de cómo evitar que la IA del futuro no esté alineada con los valores y necesidades humanas. ¡Compártelo para ayudar a su difusión!